Pierwszy semestr powoli zbliżał się do końca. Był dopiero październik - z nieznanych nam powodów wiele szkół w krajach postsowieckich uważa, że system 4-semestralny jest lepszy od standardowego. Przyszedł czas testowania.

Początkowo pomyślałem, że będzie smutno: wielu uczniów było całkowicie pod zaplanowanym poziomem kursu. Kiedy robiliśmy im testy cząstkowe ("formatywki"), wyniki wypadały różnie, ale obawiałem się, że dopiero test semestralny - "sumatywka" - pokaże jak strasznie daleko są od celów, które wyznaczone zostały na początku semestru jako konieczne do osiągnięcia przez każdego ucznia, zwanych skrótowo “term outcomes”.

Mimo, że jesteśmy chronologicznie na końcu pierwszego semestru, to pozwolę sobie zawrzeć tutaj sumę doświadczeń całego roku.

Jakie dawać oceny? Szkoły wcielające w życie curriculum IB zasadniczo nie marzą o ocenach. Lansowane są raczej raporty postępu, które pozwalają dokładniej oddać to, czy ktoś ostatnimi czasy robi wszystko, czy też wali w bambus. Najczęściej ten raport powinno się pisać w oparciu o jakiś projekt semestralny, który cała klasa z pasją realizuje, a którego temat powinien być interdyscyplinarny i uzgodniony z nauczycielami innych przedmiotów. Ta piękna idea sprawdza się całkiem dobrze w szkołach, do których trafiają dzieci po odbyciu już podstawowej edukacji z języka angielskiego, dzięki której potrafią wyrażać swoje opinie, uzasadniać swoje wybory i zadawać dociekliwe pytania nauczycielowi, którego rolą jest bardziej wspierać uczniów w ich własnych poszukiwaniach naukowych, niż narzucanie swojej wizji tego, czego powinni się akurat teraz uczyć. Oczywiście wymaga to też od nauczyciela odpowiedniego przygotowania merytorycznego, zwłaszcza pomysłów na to, jak łączyć naukę języka z nauką o świecie w ogóle, oraz podstawowej wiedzy na temat tego, jak zarządzać grupami uczniów - czyli jak przypisywać im role w projektach, jak pilnować dyscypliny kiedy mają pracować samodzielnie, jak zachęcać do pracy osoby niezaangażowane itp. Kiedy więc te wszystkie warunki konieczne zostają spełnione, edukator jest w stanie ocenić uczniów poprzez obserwację nie tylko samych kompetencji językowych pacjenta, ale też ich wkładu w pracę całej grupy.

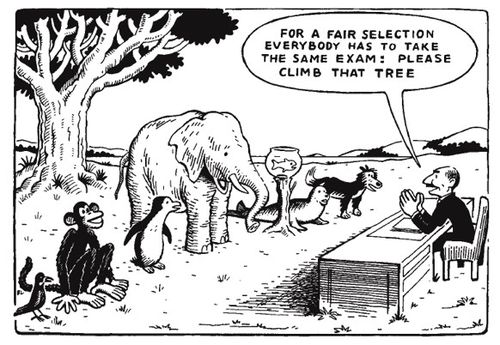

Tyle teorii. W praktyce nasza astańska szkoła uparła się, aby przenieść curriculum IB na uczniów, którzy nie mówili po angielsku, bądź byli po zaledwie 2-3 latach nieudolnej nauki tego języka. Do grup dzieci rozpoczynających edukację trafiały jednak często jednostki, które mieszkały kilka lat w Dubaju czy USA i mówiły płynnie w języku wroga. O projektach prowadzonych przez całą klasę nie mogło być mowy, ponieważ wszystkie te zalecane przez organizację IB były zbyt trudne, konieczne więc było przeprowadzanie testów. Co jednak zrobić, jeżeli w jednej sali siedzi osoba mówiąca całkiem dobrze i osoba nie potrafiąca czytać? Dać im jeden test? Dwa różne? A jak potem przeliczyć to wszystko? W ISA wymyślono więc system, który każdy rozumiał inaczej, ale mimo tej różnorodności podejść, wszystkie rezultaty były podobnie demotywujące dla wszystkich zaangażowanych.

Wariantów było parę: w ramach formatywek zazwyczaj dawało się słabszym uczniom łatwiejsze testy, a lepszym trudniejsze. Tylko jak to potem ocenić? Jedni dawali pełną skalę, więc w sumie opłacało się być słabym, bo dostaniesz łatwiejszy test, wykręcisz z niego 5 i tyle. W tym czasie ktoś z trudniejszym testem napisze na 4, więc ma niższą ocenę od ciebie, chociaż przecież umie lepiej (przynajmniej zdaniem nauczyciela, który tak pacjenta ocenił podczas przydzielania do różnych grup testowych).

Inni uważali, że uczniowie dostający łatwiejszy test nie mogą dostać z niego więcej niż 4. Ależ jest to motywujące, jak się nie zepniesz, to i tak ponad 4 nie wyskoczysz!

Po paru miesiącach mieliśmy z uczniami układ, że jak napiszą ten łatwiejszy, to dostają trudniejszy, żeby spróbować na 5. Nigdy nikomu się nie udało, większość po jakimś czasie prawie nawet nie próbowała.

Może wam się nasunąć tutaj pewna grzeszna myśl: Hm, a może podzielić ich na grupy pod kątem znajomości języka?

Nie, nie, tak nie wolno, to by zabiło ideę IB!!!

Początkowo pomyślałem, że będzie smutno: wielu uczniów było całkowicie pod zaplanowanym poziomem kursu. Kiedy robiliśmy im testy cząstkowe ("formatywki"), wyniki wypadały różnie, ale obawiałem się, że dopiero test semestralny - "sumatywka" - pokaże jak strasznie daleko są od celów, które wyznaczone zostały na początku semestru jako konieczne do osiągnięcia przez każdego ucznia, zwanych skrótowo “term outcomes”.

Mimo, że jesteśmy chronologicznie na końcu pierwszego semestru, to pozwolę sobie zawrzeć tutaj sumę doświadczeń całego roku.

Jakie dawać oceny? Szkoły wcielające w życie curriculum IB zasadniczo nie marzą o ocenach. Lansowane są raczej raporty postępu, które pozwalają dokładniej oddać to, czy ktoś ostatnimi czasy robi wszystko, czy też wali w bambus. Najczęściej ten raport powinno się pisać w oparciu o jakiś projekt semestralny, który cała klasa z pasją realizuje, a którego temat powinien być interdyscyplinarny i uzgodniony z nauczycielami innych przedmiotów. Ta piękna idea sprawdza się całkiem dobrze w szkołach, do których trafiają dzieci po odbyciu już podstawowej edukacji z języka angielskiego, dzięki której potrafią wyrażać swoje opinie, uzasadniać swoje wybory i zadawać dociekliwe pytania nauczycielowi, którego rolą jest bardziej wspierać uczniów w ich własnych poszukiwaniach naukowych, niż narzucanie swojej wizji tego, czego powinni się akurat teraz uczyć. Oczywiście wymaga to też od nauczyciela odpowiedniego przygotowania merytorycznego, zwłaszcza pomysłów na to, jak łączyć naukę języka z nauką o świecie w ogóle, oraz podstawowej wiedzy na temat tego, jak zarządzać grupami uczniów - czyli jak przypisywać im role w projektach, jak pilnować dyscypliny kiedy mają pracować samodzielnie, jak zachęcać do pracy osoby niezaangażowane itp. Kiedy więc te wszystkie warunki konieczne zostają spełnione, edukator jest w stanie ocenić uczniów poprzez obserwację nie tylko samych kompetencji językowych pacjenta, ale też ich wkładu w pracę całej grupy.

Tyle teorii. W praktyce nasza astańska szkoła uparła się, aby przenieść curriculum IB na uczniów, którzy nie mówili po angielsku, bądź byli po zaledwie 2-3 latach nieudolnej nauki tego języka. Do grup dzieci rozpoczynających edukację trafiały jednak często jednostki, które mieszkały kilka lat w Dubaju czy USA i mówiły płynnie w języku wroga. O projektach prowadzonych przez całą klasę nie mogło być mowy, ponieważ wszystkie te zalecane przez organizację IB były zbyt trudne, konieczne więc było przeprowadzanie testów. Co jednak zrobić, jeżeli w jednej sali siedzi osoba mówiąca całkiem dobrze i osoba nie potrafiąca czytać? Dać im jeden test? Dwa różne? A jak potem przeliczyć to wszystko? W ISA wymyślono więc system, który każdy rozumiał inaczej, ale mimo tej różnorodności podejść, wszystkie rezultaty były podobnie demotywujące dla wszystkich zaangażowanych.

Wariantów było parę: w ramach formatywek zazwyczaj dawało się słabszym uczniom łatwiejsze testy, a lepszym trudniejsze. Tylko jak to potem ocenić? Jedni dawali pełną skalę, więc w sumie opłacało się być słabym, bo dostaniesz łatwiejszy test, wykręcisz z niego 5 i tyle. W tym czasie ktoś z trudniejszym testem napisze na 4, więc ma niższą ocenę od ciebie, chociaż przecież umie lepiej (przynajmniej zdaniem nauczyciela, który tak pacjenta ocenił podczas przydzielania do różnych grup testowych).

Inni uważali, że uczniowie dostający łatwiejszy test nie mogą dostać z niego więcej niż 4. Ależ jest to motywujące, jak się nie zepniesz, to i tak ponad 4 nie wyskoczysz!

Po paru miesiącach mieliśmy z uczniami układ, że jak napiszą ten łatwiejszy, to dostają trudniejszy, żeby spróbować na 5. Nigdy nikomu się nie udało, większość po jakimś czasie prawie nawet nie próbowała.

Może wam się nasunąć tutaj pewna grzeszna myśl: Hm, a może podzielić ich na grupy pod kątem znajomości języka?

Nie, nie, tak nie wolno, to by zabiło ideę IB!!!

W jakimś drugim tygodniu mieliśmy spotkanie, na którym poinformowano nas, że oceny są, ale docelowo chcieliby je zlikwidować, bo są one zawsze nieuczciwe i krzywdzące. Teoria była taka: dajmy na to ktoś chodził do szkoły kilka lat i odkrył w sobie wielką pasję do gry na trąbce. Za to ocenić się go nie da, więc jest to krańcowo nieuczciwe, bo spędził tyle czasu szkoląc się w tej trudnej sztuce. Trochę zacząłem głupieć, bo jednak zmierzyć czyjąś znajomość języka nie jest bardzo trudno i niekoniecznie musi to być związane z zajechaniem pacjenta do łez. Szkoły muzyczne też na ogół radzą sobie z ocenianiem zdolności grania na instrumentach, więc dlaczego miałaby się tym zajmować szkoła podstawowa?

Oczywiście każdy test jest w jakimś sensie niesprawiedliwy, ktoś może mieć gorszy dzień, odpowiedzieć nieszablonowo, ale skoro uczeń spędza na angielskim 4x40 minut w tygodniu (+ English Club + dodatkowe zajęcia) to jest taki nakład czasu, że głupio, żeby z tego wyszło jedynie granie na trąbce. Do tego testowanie języka to często też już nie jest jakiś nonsens, w którym trzeba idealnie trafić w klucz, oceniając można używać zdrowego rozsądku i wychodzić poza modelowe odpowiedzi, a potem zamiast wystawiać oceny napisać raport, że w ostatnich tygodniach pracował rewelacyjnie i że chociaż na teście to słabo widać, to jest cudownie. Albo w drugą stronę, że test napisany cudownie, ale w trakcie lekcji niczego nie robi i bazuje na wiedzy, którą zdobył mieszkając przez dwa lata w Kanadzie.

Gdy robiłem Deltę, to zainteresowało mnie jak się pisze testy. Wydawało mi się, że jest to najbardziej oczywista rzecz świata, że jest tyle wskaźników decydujących o wartości testu, że użycie kombinacji doświadczenia i zdrowego rozsądku pozwala na przetestowanie ucznia z każdej strony i otrzymanie dość miarodajnych rezultatów. Jedno z ćwiczeń na Delcie polega na ocenie przydatności testu dla ucznia, częściej grupy uczniów. Myślę, że nie tylko dla mnie było to jedno z najbardziej oczywistych ćwiczeń.

W kilka miesięcy po tym pokarało mnie solidnie, gdy rozpocząłem pracę z ludźmi, dla których nie było to takie oczywiste, bo w życiu za wiele nie uczyli, a jak uczyli, to w Chinach, Korei Południowej lub na Bliskim Wschodzie, czyli rynkach, które płacą bardzo przyjemnie, ale są niekompatybilne z bardziej klasycznymi systemami nauczania.

Z doświadczenia wynika, że jeżeli system testowania w szkole jest chujowy, to oceny są nieuczciwe. A jeżeli nauczyciele go sami takim tworzą, to co nam to mówi o kadrach?

Oczywiście każdy test jest w jakimś sensie niesprawiedliwy, ktoś może mieć gorszy dzień, odpowiedzieć nieszablonowo, ale skoro uczeń spędza na angielskim 4x40 minut w tygodniu (+ English Club + dodatkowe zajęcia) to jest taki nakład czasu, że głupio, żeby z tego wyszło jedynie granie na trąbce. Do tego testowanie języka to często też już nie jest jakiś nonsens, w którym trzeba idealnie trafić w klucz, oceniając można używać zdrowego rozsądku i wychodzić poza modelowe odpowiedzi, a potem zamiast wystawiać oceny napisać raport, że w ostatnich tygodniach pracował rewelacyjnie i że chociaż na teście to słabo widać, to jest cudownie. Albo w drugą stronę, że test napisany cudownie, ale w trakcie lekcji niczego nie robi i bazuje na wiedzy, którą zdobył mieszkając przez dwa lata w Kanadzie.

Gdy robiłem Deltę, to zainteresowało mnie jak się pisze testy. Wydawało mi się, że jest to najbardziej oczywista rzecz świata, że jest tyle wskaźników decydujących o wartości testu, że użycie kombinacji doświadczenia i zdrowego rozsądku pozwala na przetestowanie ucznia z każdej strony i otrzymanie dość miarodajnych rezultatów. Jedno z ćwiczeń na Delcie polega na ocenie przydatności testu dla ucznia, częściej grupy uczniów. Myślę, że nie tylko dla mnie było to jedno z najbardziej oczywistych ćwiczeń.

W kilka miesięcy po tym pokarało mnie solidnie, gdy rozpocząłem pracę z ludźmi, dla których nie było to takie oczywiste, bo w życiu za wiele nie uczyli, a jak uczyli, to w Chinach, Korei Południowej lub na Bliskim Wschodzie, czyli rynkach, które płacą bardzo przyjemnie, ale są niekompatybilne z bardziej klasycznymi systemami nauczania.

Z doświadczenia wynika, że jeżeli system testowania w szkole jest chujowy, to oceny są nieuczciwe. A jeżeli nauczyciele go sami takim tworzą, to co nam to mówi o kadrach?

Jedyne spotkania, na których lokalni się jakoś budzili, to są te związane z pisaniem testów końcowych - wszystkie testy były przygotowywane przez nauczycieli przedmiotowych. W efekcie wszyscy robili je tak, żeby uczniowie zdali na pięć. Podczas spotkań natrafiało się na całą kaskadę problemów. Po pierwsze, jeżeli testy napiszą jacyś ambitni obcokrajowcy, to bardzo szybko coś (jak nie wszystko) odpadnie jako za trudne. Dlatego lokalne nauczycielki uwalały wszystkie ambitniejsze ćwiczenia. Wszystko było więc poniżej poziomu zajęć, ale i tak niektórzy oblewali z łoskotem. W efekcie test mający sprawdzić znajomość Present Continuous wyglądał mniej więcej tak:

Match affirmative and negative sentences. (Przetłumaczone na ruski oralnie)

I am swimming. I am not eating.

I am eating. I am not swimming.

Bardzo trudne, bardzo miarodajne, bardzo pokazujące nam, że uczniowie znają ten czas, potrafią go używać w sposób swobodny. Układanie pytań? Pytań się nauczą za rok. Nie wiem kiedy i z czego, bo w następnej części podręcznika nie ma. Zresztą ten dramat związany z tym, że nie bardzo powinno się zaczynać część czwartą podręcznika, gdy jest się w połowie trzeciej, dopadał wszystkich lokalnych. Winne oczywiście było wydawnictwo Oxford, bo przecież autorzy serii 'Family and Friends' powinni byli założyć, że wypierdolicie połowę kursu i przejdziecie do kolejnej książki, więc tam wam ją powinni powtórzyć.

Jak stestować znajomość Present Simple?

Uczniowie mają wpasować czasownik do zdania.

Wyglądało to tak

I_____ football.

I ______ breakfast.

Opcje do wyboru: Play, eat.

Tak, dokładnie tak to działa, jeżeli potrafisz zrobić takie ćwiczenie, to wymiatasz Present Simple!

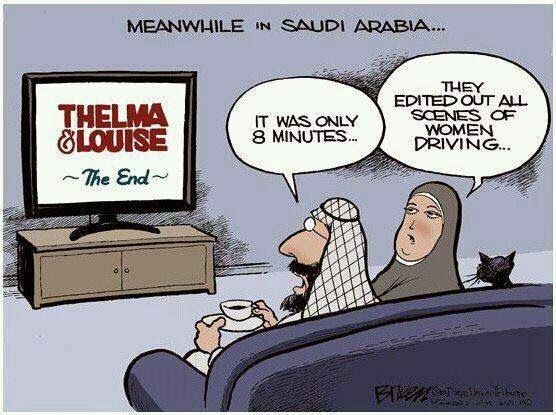

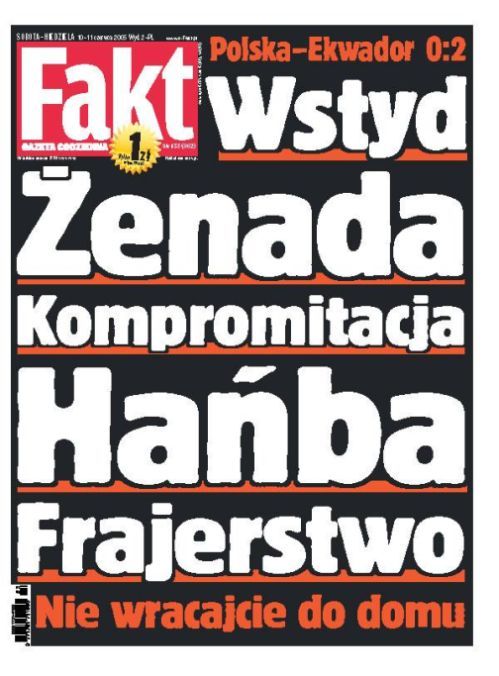

Chwilami wydawało się to niemożliwe, ale jak do pracy ludzie w Kazachstanie się nie nadają, tak do prymitywnego kombinowania pasji im nie brakowało. Efekty były takie, że z każdego cywilizowanego miejsca by ich wywalili na kopach i z wilczym biletem, ale nie zapominajmy gdzie się to wszystko działo. Chińczycy potrafili bredzić i kombinować, ale nie zbliżyli się do poziomów Astany, bo do tych poziomów cywilizowany człowiek się nigdy nie zbliży. Żenada, frajerstwo, cwaniactwo, chamstwo, prymitywizm – to cechowało system panujący w szkole międzynarodowej.

Przerażało nas to, jak zadowoleni tą sytuacją byli wszyscy nauczyciele, czy to kazachscy, czy obcokrajowcy. Były pewne wyjątki, ale wiele osób z RPA uczyło w tym systemie kolejny rok i uważało, że jest to w porządku.

Match affirmative and negative sentences. (Przetłumaczone na ruski oralnie)

I am swimming. I am not eating.

I am eating. I am not swimming.

Bardzo trudne, bardzo miarodajne, bardzo pokazujące nam, że uczniowie znają ten czas, potrafią go używać w sposób swobodny. Układanie pytań? Pytań się nauczą za rok. Nie wiem kiedy i z czego, bo w następnej części podręcznika nie ma. Zresztą ten dramat związany z tym, że nie bardzo powinno się zaczynać część czwartą podręcznika, gdy jest się w połowie trzeciej, dopadał wszystkich lokalnych. Winne oczywiście było wydawnictwo Oxford, bo przecież autorzy serii 'Family and Friends' powinni byli założyć, że wypierdolicie połowę kursu i przejdziecie do kolejnej książki, więc tam wam ją powinni powtórzyć.

Jak stestować znajomość Present Simple?

Uczniowie mają wpasować czasownik do zdania.

Wyglądało to tak

I_____ football.

I ______ breakfast.

Opcje do wyboru: Play, eat.

Tak, dokładnie tak to działa, jeżeli potrafisz zrobić takie ćwiczenie, to wymiatasz Present Simple!

Chwilami wydawało się to niemożliwe, ale jak do pracy ludzie w Kazachstanie się nie nadają, tak do prymitywnego kombinowania pasji im nie brakowało. Efekty były takie, że z każdego cywilizowanego miejsca by ich wywalili na kopach i z wilczym biletem, ale nie zapominajmy gdzie się to wszystko działo. Chińczycy potrafili bredzić i kombinować, ale nie zbliżyli się do poziomów Astany, bo do tych poziomów cywilizowany człowiek się nigdy nie zbliży. Żenada, frajerstwo, cwaniactwo, chamstwo, prymitywizm – to cechowało system panujący w szkole międzynarodowej.

Przerażało nas to, jak zadowoleni tą sytuacją byli wszyscy nauczyciele, czy to kazachscy, czy obcokrajowcy. Były pewne wyjątki, ale wiele osób z RPA uczyło w tym systemie kolejny rok i uważało, że jest to w porządku.

Wisienek na torcie nie brakowało, bo każdy test niekońcowy musi być na 8 punktów. ZAWSZE NA 8!!! Ewentualnie ich wielokrotność, więc najczęściej pisaliśmy na 16. Jeżeli masz w ćwiczeniu osiem zdań-ćwiczeń, to nie ma sprawy, ale co jak ci się złoży, że masz dziesięć? Wywalasz dwa i zostawiasz osiem. Niestety, czasem ktoś lokalny (obcokrajowcy zazwyczaj umieli w matematykę na takim poziomie) się rozpędzał i zrobił test, który by normalnie wyszedł na 17 punktów. Co się działo dalej?

Powiedzmy, że są trzy ćwiczenia. W efekcie pisano punktację w stylu

- ćwiczenie pierwsze, pięć przykładów po 1,2 punktu każdy, czyli 6 punktów.

- ćwiczenie drugie, 8 przykładów po 0,5 punktu za każdy, czyli 4.

- ćwiczenie trzecie, 4 przykłady. Każdy po 1,5, czyli 6, czyli mamy 16, Hallelujah! A very broken hallelujah. Dzielimy na 2, mamy wartość punktową jaką mamy mieć. Najgorsze, gdy po takiej zabawie wstanie klient z Polski i mówi:

- To fajnie, ale ćwiczenie drugie jest o wiele trudniejsze, uczniowie muszą dokonać całej transformacji zdania i je napisać. Istnieje znacznie więcej miejsc, w których mogą się pomylić. Tymczasem ćwiczenie trzecie jest bardzo proste, nie wymaga nawet znajomości języka, obrazki można połączyć na oko. Dystrybucja punktów jest błędna, demotywująca i nie oddająca faktycznego poziomu uczniów.

Mózgi eksplodują, bo z matematyką szału nie było. Jak już ogarniali, co miałem na myśli, to dowiadywałem się, że przecież w drugim potracą wiele punktów, więc niech tracą jak najmniej, a w trzecim odrobią. To jeżeli miałem dzień, to pytałem, czy robimy test, żeby mieć papier, czy żeby cokolwiek sprawdzić i obadać? Standardowa odpowiedź, słyszana po milion razy: oczywiście, że obadać, ale przecież nie można ich demotywować, to byłoby wbrew IB!

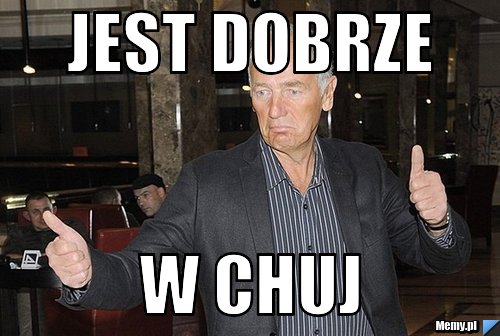

Jak czasem komuś dalibyśmy połowę punktu z 1,5, to 0,75, do tego może jeszcze 1/4 z tych przykładów po 0,5, to już w ogóle byłby totalny chaos. Tak jednak nigdy nie było, wszystko zawyżano do następnego pełnego punktu. Testy często pełne były ćwiczeń, które nie sprawdzały właściwie niczego. Wyniki cudowne, pewnego dnia 11 na 12 uczniów otrzymało 8/8, jeden nieszczęśnik 7/8. Uznano, że to był dobry test i tak będziemy dalej pisać.

Kiedyś w Moskwie mówiono mi, że jeżeli cała grupa pisze powyżej 80%, to znaczy, że test był zbyt prosty lub, że grupa jest na złym poziomie. Oczywiście takie wyniki w Kazachstanie oznaczały to, że sprawy miały się idealnie.

Powiedzmy, że są trzy ćwiczenia. W efekcie pisano punktację w stylu

- ćwiczenie pierwsze, pięć przykładów po 1,2 punktu każdy, czyli 6 punktów.

- ćwiczenie drugie, 8 przykładów po 0,5 punktu za każdy, czyli 4.

- ćwiczenie trzecie, 4 przykłady. Każdy po 1,5, czyli 6, czyli mamy 16, Hallelujah! A very broken hallelujah. Dzielimy na 2, mamy wartość punktową jaką mamy mieć. Najgorsze, gdy po takiej zabawie wstanie klient z Polski i mówi:

- To fajnie, ale ćwiczenie drugie jest o wiele trudniejsze, uczniowie muszą dokonać całej transformacji zdania i je napisać. Istnieje znacznie więcej miejsc, w których mogą się pomylić. Tymczasem ćwiczenie trzecie jest bardzo proste, nie wymaga nawet znajomości języka, obrazki można połączyć na oko. Dystrybucja punktów jest błędna, demotywująca i nie oddająca faktycznego poziomu uczniów.

Mózgi eksplodują, bo z matematyką szału nie było. Jak już ogarniali, co miałem na myśli, to dowiadywałem się, że przecież w drugim potracą wiele punktów, więc niech tracą jak najmniej, a w trzecim odrobią. To jeżeli miałem dzień, to pytałem, czy robimy test, żeby mieć papier, czy żeby cokolwiek sprawdzić i obadać? Standardowa odpowiedź, słyszana po milion razy: oczywiście, że obadać, ale przecież nie można ich demotywować, to byłoby wbrew IB!

Jak czasem komuś dalibyśmy połowę punktu z 1,5, to 0,75, do tego może jeszcze 1/4 z tych przykładów po 0,5, to już w ogóle byłby totalny chaos. Tak jednak nigdy nie było, wszystko zawyżano do następnego pełnego punktu. Testy często pełne były ćwiczeń, które nie sprawdzały właściwie niczego. Wyniki cudowne, pewnego dnia 11 na 12 uczniów otrzymało 8/8, jeden nieszczęśnik 7/8. Uznano, że to był dobry test i tak będziemy dalej pisać.

Kiedyś w Moskwie mówiono mi, że jeżeli cała grupa pisze powyżej 80%, to znaczy, że test był zbyt prosty lub, że grupa jest na złym poziomie. Oczywiście takie wyniki w Kazachstanie oznaczały to, że sprawy miały się idealnie.

Zapytałem któregoś razu o uzasadnianie wystawianych ocen w sposób opisowy i dowiedziałem się, że na każdą notę trzeba mieć podkładkę, na wypadek gdyby ktoś miał pretensje do nauczyciela o wystawioną ocenę. Zwłaszcza na ocenę niższą niż 5 (a skala była od 2 do 5). Lista osób z pretensjami była długa, o ile rodziców chcących wiedzieć o faktycznej wiedzy ucznia doskonale się rozumie, to już dyrektor trujący dupę nauczycielowi o to, że ktoś dostał 4 zamiast 5, to wyższa forma szaleństwa. Ale to nic - od drugiego semestru sprawę ułatwiono nam całkowicie, wydając oficjalny zakaz stawiania 3. Dzięki temu średnia poziomów była w okolicach 4,9-4,7. To zrodziło kolejny dramat.

System głosił, że w semestrze mamy mieć trzy formatywki (lub cztery - jeżeli mieliśmy aż taką ambicję i pasję, to wtedy wybierało się uczniom trzy najwyższe oceny), a potem sumatywkę. Z trzech formatywek uczniowie zbierają XX/24 punkty. Z sumatywki zbierają XX/24 punkty. Dodajemy sobie, dzielimy na dwa i wychodzi nam uczciwa, dobra ocena. Jeżeli nie, to lokalni przekręcają testy wstecz lub przeliczają punkty ponownie.

Uczniowie piszą testy, zaliczamy odpowiedzi, które są lata świetlne od poprawnych, księgujemy papier i wypełniamy systemy, amen. Do następnego razu. A jeżeli semestr jest bardzo krótki? Ilość testów jest sztywna (to dopiero jest bardzo IB!), więc może się okazać, że piszesz trzeci w tym tygodniu test z diabli wiedzą czego i diabli wiedzą po co. Znaczy po co było zawsze wiadome: żeby mieć papier. Na koniec roku wszystkie testy niszczono. Zapewne po to, żeby jakaś kontrola nie znalazła tych osiągnięć rzeźbienia w gównie.

Nigdy, nigdzie nie widziałem takiej lipy. To może lepiej byłoby ich w ogóle nie testować? Byłoby, ale z jakiegoś powodu - zapewne nostalgii za Związkiem Radzieckim - wymyślono obłędną ilość testów. Nigdy nie musiałem męczyć uczniów tak bardzo i tak często. Drugi semestr to był rekord, nie było tygodnia bez testu, do tego przedostatni tydzień cały składał się z testowania. Test co trzy lekcje, a czasem nawet co dwie. Test z diabli wiedzą czego, test żeby napisać test. Idiotyzm, strata czasu, a według lokalnych 'duch IB'.

Jeszcze może słowo o systemach informatycznych, z których mieliśmy przyjemność korzystać. Wydawało się, że współcześnie stworzenie systemu, który zbiera cztery oceny i wylicza uczniowi średnią, to nie powinno być wyzwanie na miarę lotu na księżyc w 1969. Oczywiście okazało się, że zawieść może jednocześnie czynnik ludzki i techniczny. Po pierwsze, ludziom się mylili uczniowie i przedmioty.

Powiedzmy, że daliśmy uczniowi 22 punkty.

Dwa dni później okazuje się, że uczeń ma 18.

Jak to możliwe?

Nauczyciel innego przedmiotu pomylił sobie kolumny i wpisał swoje w angielskim.

Przyznam, ze zdarzył się JEDEN przypadek, że ktoś wpisał coś niższego niż ja. Zresztą w trzeciej klasie nikt jakoś dziko nie pałuje i bardzo ich nie piłuje, ale już w czwartej powoli się urealnia oceny (to znaczy w moim świecie, bo w świecie NIS ocen nie urealnia się nigdy i zawsze daje piąteczki).

To jednak było małe miki. Błąd techniczny dostarczył nam o wiele więcej radości. Po wprowadzeniu ocen do systemu, okazało się, że automatycznie wyliczone wyniki wyglądały mniej więcej tak:

24/24 - dostateczny

23 - bardzo dobry

22 - dobry

21 - niedostateczny

19- bardzo dobry

18 - niedostateczny

13 - bardzo dobry

Dwa dni to naprawiali. Potem okazało się, że danie komukolwiek jakiejkolwiek połówki (np. 23,5) powoduje, że znowu dzieje się nonsens i każda ocena z połówką to dostateczny. Cieszyliśmy, że możemy wszystko robić na ostatnią chwilę, że trzeba to wpisywać po kilka razy, zrobić wersję papierową na wszelki wypadek. Niech żyje automatyzacja!

System głosił, że w semestrze mamy mieć trzy formatywki (lub cztery - jeżeli mieliśmy aż taką ambicję i pasję, to wtedy wybierało się uczniom trzy najwyższe oceny), a potem sumatywkę. Z trzech formatywek uczniowie zbierają XX/24 punkty. Z sumatywki zbierają XX/24 punkty. Dodajemy sobie, dzielimy na dwa i wychodzi nam uczciwa, dobra ocena. Jeżeli nie, to lokalni przekręcają testy wstecz lub przeliczają punkty ponownie.

Uczniowie piszą testy, zaliczamy odpowiedzi, które są lata świetlne od poprawnych, księgujemy papier i wypełniamy systemy, amen. Do następnego razu. A jeżeli semestr jest bardzo krótki? Ilość testów jest sztywna (to dopiero jest bardzo IB!), więc może się okazać, że piszesz trzeci w tym tygodniu test z diabli wiedzą czego i diabli wiedzą po co. Znaczy po co było zawsze wiadome: żeby mieć papier. Na koniec roku wszystkie testy niszczono. Zapewne po to, żeby jakaś kontrola nie znalazła tych osiągnięć rzeźbienia w gównie.

Nigdy, nigdzie nie widziałem takiej lipy. To może lepiej byłoby ich w ogóle nie testować? Byłoby, ale z jakiegoś powodu - zapewne nostalgii za Związkiem Radzieckim - wymyślono obłędną ilość testów. Nigdy nie musiałem męczyć uczniów tak bardzo i tak często. Drugi semestr to był rekord, nie było tygodnia bez testu, do tego przedostatni tydzień cały składał się z testowania. Test co trzy lekcje, a czasem nawet co dwie. Test z diabli wiedzą czego, test żeby napisać test. Idiotyzm, strata czasu, a według lokalnych 'duch IB'.

Jeszcze może słowo o systemach informatycznych, z których mieliśmy przyjemność korzystać. Wydawało się, że współcześnie stworzenie systemu, który zbiera cztery oceny i wylicza uczniowi średnią, to nie powinno być wyzwanie na miarę lotu na księżyc w 1969. Oczywiście okazało się, że zawieść może jednocześnie czynnik ludzki i techniczny. Po pierwsze, ludziom się mylili uczniowie i przedmioty.

Powiedzmy, że daliśmy uczniowi 22 punkty.

Dwa dni później okazuje się, że uczeń ma 18.

Jak to możliwe?

Nauczyciel innego przedmiotu pomylił sobie kolumny i wpisał swoje w angielskim.

Przyznam, ze zdarzył się JEDEN przypadek, że ktoś wpisał coś niższego niż ja. Zresztą w trzeciej klasie nikt jakoś dziko nie pałuje i bardzo ich nie piłuje, ale już w czwartej powoli się urealnia oceny (to znaczy w moim świecie, bo w świecie NIS ocen nie urealnia się nigdy i zawsze daje piąteczki).

To jednak było małe miki. Błąd techniczny dostarczył nam o wiele więcej radości. Po wprowadzeniu ocen do systemu, okazało się, że automatycznie wyliczone wyniki wyglądały mniej więcej tak:

24/24 - dostateczny

23 - bardzo dobry

22 - dobry

21 - niedostateczny

19- bardzo dobry

18 - niedostateczny

13 - bardzo dobry

Dwa dni to naprawiali. Potem okazało się, że danie komukolwiek jakiejkolwiek połówki (np. 23,5) powoduje, że znowu dzieje się nonsens i każda ocena z połówką to dostateczny. Cieszyliśmy, że możemy wszystko robić na ostatnią chwilę, że trzeba to wpisywać po kilka razy, zrobić wersję papierową na wszelki wypadek. Niech żyje automatyzacja!

Na końcu drugiego semestru wszedł w życie zakaz stawiania ocen niższych od czterech, więc lokalni w pocie czoła czochrali system i szukali, czy aby komuś nie wyszła trójczyna. Co z tego, że w papierze się wszystko zgadzało, to system decydował o tym, czy będą mieli rozmowę na dywaniku, czy nie. Zresztą wtedy system się wypierdolił z łoskotem i pisaliśmy wszystko na piechotę w Excelu, łącznie z personaliami uczniów.

RSS Feed

RSS Feed